#51 Verificación de edad y otros dilemas de "suma cero"

Y el caso del control reversible del Gobierno iraní

El tema de la verificación de edad está de moda.

Todo el mundo lo ve bien.

El objetivo de protección de los menores es indiscutible y eso cataliza la opinión pública a favor de la medida.

Es posible que seas, como nosotros, una alma preocupada por efectos de segundo orden, más aún cuando esos efectos pueden hacer polvo el derecho de privacidad -base, como sabemos, de todos los demás derechos-.

Y como ya sabes, cualquiera es capaz de decir “es por los niños” en un segundo y queda de puta madre, y a ti te cuesta cinco buenos y titubeantes minutos en explicar esos riesgos que hasta a ti te parecen remotos mientras tratas duramente de simplificarlos.

Más abajo cubrimos un ejemplo demoledor de cómo el sistema de videocámaras de vigilancia instalado por un Gobierno (el iraní) fue clave en su propia destrucción, una vez hackeado por un tercero hostil.

Pero nosotros estábamos pensando en una herramienta blanca, interactiva, clara, con ejemplitos, enlaces y cierta coña marinera marca de la casa.

Pues bien, no temas: aquí está lo que buscabas.

Hemos montado este artefacto interactivo a medias con Claude.

Substack no nos permite meter iframes para que lo bichees directamente aquí, así que os insertamos sólo un vídeo demostrativo y el enlace para que lo reviséis, critiquéis y compartáis a vuestro gusto.

Estás leyendo ZERO PARTY DATA. La newsletter sobre actualidad y derecho tecnológico de Jorge García Herrero y Darío López Rincón.

En los ratos libres que nos deja esta newsletter, resolvemos movidas complicadas relacionadas con la normativa de protección de datos personales e inteligencia artificial. Si tienes de alguna de esas, haznos así con la manita. O contáctanos por correo en jgh(arroba)jorgegarciaherrero.com

🗞️Noticias del Mundodato 🌍

.- De país de la Cartera Digital Beta que parece que podría haber sido la base para el EU Digital Identity Wallet, llega una clásica de la digitalización pública española.

.- Mis dieces para esto de Nicholas Thompson: Israel reportedly hacked Iran's traffic cameras and had total vision into the movements of Ayatollah Khamenei and his guards

La tesis central aquí es que la infraestructura de vigilancia tiene una vulnerabilidad simétrica inherente: quien observa puede acabar siendo observado a través de su propio sistema.

El plot twist es arrasador: cámaras desplegadas para control interno habrían sido reutilizadas por un adversario para monitorizar los propios movimientos del poder iraní. La moraleja no es solo de ciberseguridad estatal, sino de arquitectura política: cada red masiva de visibilidad genera una superficie reutilizable contra su propio operador. La derrota más profunda no es de seguridad sino doctrinal: un sistema concebido para controlar a la población acabó coadyuvando a la eliminación del soberano que lo dispuso.

Ese es el tuit.

Y esto es asín con independencia del color del soberano.

.- Otra de Nicholas de ayer: Claude se ha convertido en el puto alumno listillo que no quieres tener que evaluar.

.- Researchers trick a bot that prescribes meds. Este caso muestra que los sistemas de IA clínica siguen fallando en el punto menos aceptable: la seguridad operacional. Mindgard logró alterar el comportamiento del bot de Doctronic -usado en un sandbox, a Dios gracias- induciendo recomendaciones falsas sobre vacunas, metanfetamina y dosis de OxyContin. Los “guardrails” conversacionales no garantizan un control clínico robusto: el ataque no necesitó técnicas exóticas.

.- Este texto de Sam Bent pone en jaque el marketing maximalista de privacidad de Proton. Su tesis es que el “zero access” de Proton sólo se refiere a datos en reposo, no a todos los momentos del flujo; además, pagos, metadatos y otros puntos siguen dejando superficie de exposición. A raíz del caso del activista de Atlanta se presenta el asunto como un patrón, más que como una anomalía. Lo que más me ha llamado la atención es su apunte final: el verdadero producto de Proton quizá no sea la invulnerabilidad técnica, sino una semántica cuidadosamente administrada sobre dónde termina exactamente su promesa.

Aquí hemos utilizado la suite de Proton desde casi el primer día y tengo que reconocer que no aspiro a la invulnerabilidad frente a requerimientos de autoridades judiciales, sino frente a terceros atacantes ilegítimos. Dicho esto, siempre hay que estar atento a esos momentos en los que las personas de confianza demuestran no cumplir sus compromisos, o hablar con lengua de serpiente.

📖 Documentos dateros muy cafeteros ☕️

.- Via Don Luis Montezuma: la autoridad holandesa ha publicado ayer pispo unas guidelines de sólo 11 páginas sobre decisiones automatizadas en contratación de personal. Algo que nadie aplica, vaya. Nota: la traducción a inglés es sólo vaya: cuando dice que el supervisor tiene que ser “competente” y además “competente” se refiere, en el primer caso, a “competente” en el sentido de tener las skills necesarias y en el segundo a la competencia (en el sentido de capacidad, poder) para cambiar el sentido de la propuesta automatizada.

Pero qué les voy a contar yo a ustedes de supervisión humana efectiva…

Formación RGPD + IA

¿Estás interesado en apuntarte a la próxima edición de nuestra formación para aplicar el RGPD a la IA como un auténtico samur-AI ?

Toda la info aquí, salvo las fechas, pendientes de determinar, pero en todo caso para terminar antes de julio.

Si quieres apuntarte, mándame un email, pincha aquí:

.- Vía Samuel Parra y Javier Sempere, tenemos un doble interesante de resolución de la AEPD.

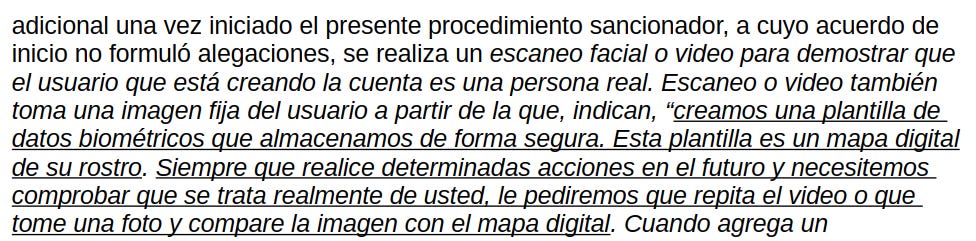

1.Los 950.000 euros que le han caído a Yoti. Uno de los grandes nombres de los sistemas de verificación de edad (el que está detrás del que usa EPIC/Fornite, y que intentaron que la FTC se lo diera paso para la COPPA). En este tipo de sistemas siempre hubo una posible duda de la aplicabilidad efectiva del 9, pero aquí queda claro que existe una plantilla biométrica en lo que ellos mismo dicen. Es decir, que no habría forma humana de intentar justificar que no podría permitir esa finalidad de identificación unívoca del 9.

Se echa de menos en la argumentación de la AEPD para decir que es un tratamiento biométrico de categoría especial, haber incorporado las directrices sobre Directrices 5/2022 sobre el uso de la tecnología de reconocimiento facial en el ámbito de la aplicación de la ley; porque casi da la sensación de que todo dato biométrico que lo sea, automáticamente sería categoría especial del 9. En estas directrices se rompió esa interpretación de que la autenticación e identificación, pero reconociendo posibles casos concretos que pudiera ser biométrico sin categoría especial.

El que te pillen una aplicación del artículo 9 que niegas en toda la documentación, te lleva en cascada a infracción de este artículo, base de legitimación y artículo 5 a lo grande. Y al estar ya en categoría especial, también el punto del tratamiento del tono de piel: el presunto tratamiento necesario por evitar errores en la estimación por variabilidad de luminosidad y melanina en la piel.

En un sector en que todas las soluciones parecen un calco, ¿podemos ya casi decir que todas incumplen por negar tratamiento de categoría especial que hacen?. Justo ahí está Discord en primer plano: K-ID como encargado, y Privately como subencargado.

2.La curiosa de NVIDIA sin sanción: curiosa porque se pide copia de las partidas guardadas, en el marco de un derecho de acceso. Puede parecer que NVIDIA sólo se decida a fabricar tarjetas gráficas, pero tiene un servicio de cloud gaming que funciona muy bien. Podríamos hablar de la corresponsabilidad inherente entre la entidad del catálogo que conectas a sus servidores y NVIDIA, pero eso da para bastante más tinta digital.

Se libra de sanción al haber cumplido unos días antes del propio escrito de alegación. Aunque sean unos cuantos meses más allá del plazo general de 30 desde el marzo que lo pidió el interesado, la AEPD lo da por zanjado al haberse satisfecho el derecho.

Si el derecho de acceso hubiera ido expresamente a pedir explicación del funcionamiento del sistema antitrampas, se hubieran intentando acoger al 15.4 para denegarlo. Modus operandi habitual, aun cuando no permite el 15.4 denegar del todo el derecho, y el EDPB dió un ejemplo muy parecido en sus directrices.

.- Interesante doc de la CNIL sobre desarrollo de sistemas de IA en el entorno de datos de salud Este documento aterriza cómo articular el sistema alrededor de datos de salud, tratando reutilización de bases, formalidades previas y cautelas específicas. La CNIL insiste en que no basta con anonimizar de forma aspiracional: hay que determinar base jurídica, gobernanza del repositorio, separación de finalidades y compatibilidad con las no pocas obligaciones regulatorias sectoriales. Es relevante que el texto está pensado para DPOs y jefes de proyecto, no solo para juristas. Autores: Aurore Gaignon, Hélène Guimiot, Charlotte Barot, Paul Valois, Félicien Vallet.

.- Comentario de Peter Craddock sobre la sentencia del Consejo de Estado francés que resolvía el recurso contra la sancionzaca de 20 millones de la CNIL a Criteo.

Este asunto me interesa bastante porque tiene todo que ver con Scania, y le he dedicado un post en lkd (con intercambios con Craddock y Mark Leister en comentarios) y el post más reposado del martes pasado.

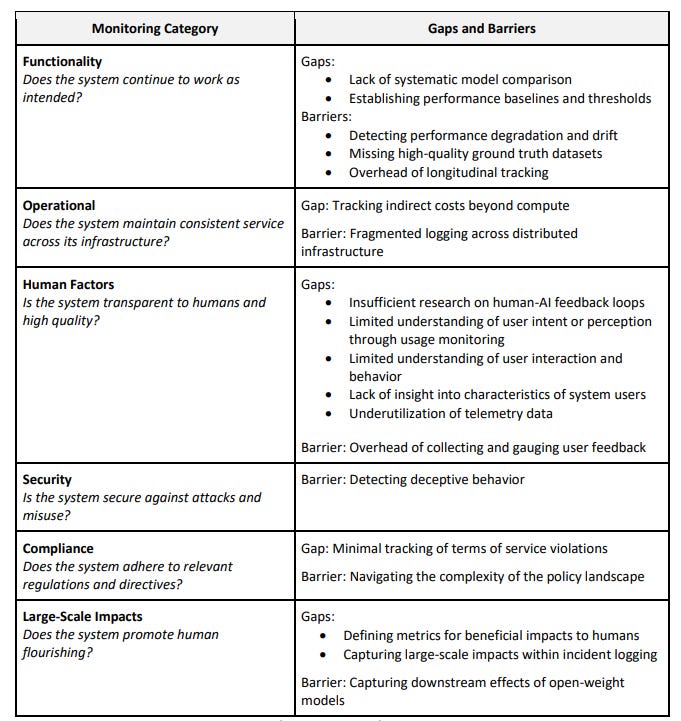

.- Este grasioso post rollo “en tu cara” de Al Zaretski corta de raíz un error muy extendido: confundir observabilidad técnica genérica con trazabilidad jurídica exigida por el RIA o AI Act. Alzaretsky desmonta varios mitos sobre logging en sistemas de alto riesgo y aclara que el uptime, API calls o crash logs no satisfacen por sí mismos el mandato del artículo 12. Provider y deployer tienen obligaciones distintas y la retención no anula ni la de minimización ni la de limitación de conservación del RGPD.

💀Death by Meme🤣

🤖NoRobots.txt o Lo de la IA

.- Ahora que empiezan a brotar las políticas de IA de "alto nivel” de muchas empresas, nos cuenta el Senado que se ha creado una. Podríamos pensar que es justo uno de los sitios en los que menos debería intentar usar nada que no puedan controlar del todo, pero todo estamos intentando usarla en nuestro propio beneficio.

La política no es nada del otro jueves, pero se pone un poco más interesantes desde el Capítulo VI – Directrices de uso. El papel aguanta muy bien el punto de minimización de datos personales, pero , también, han dejado cositas bastantes obtusas. Y sus señoría seguro que no se lo van a leer demasiado.

“Se extremará la precaución en el tratamiento de información sensible mediante sistemas de IA. En ninguna circunstancia se introducirá en un sistema de IA información sujeta a secreto parlamentario con arreglo al Reglamento del Senado, aun cuando el sistema haya sido autorizado por el Senado y funcione con información que no sea de carácter público. La información sujeta a reserva parlamentaria por no ser aún pública, o la protegida por propiedad intelectual o industrial, no se introducirá bajo ninguna circunstancia en sistemas de IA públicos, y solo se introducirá en sistemas de IA autorizados por el Senado que funcionen con información que no sea de carácter público cuando ello resulte estrictamente necesario, previa consulta a la persona superior jerárquica correspondiente.”

.- Se viene nueva curva en la parte de IA del Digital Omnibus. Parece que Francia, Españita, Alemania y Eslovaquia han jugado a la minoría de bloqueo para que se metan en el texto dos prohibiciones concretas: los sistemas de IA capaces de generar imágenes íntimas, vídeos y contenidos similares no consentidos (NCII) y el material de abuso sexual infantil (CSAM). Luca Bertuzzi, nos mantiene a todos al tanto (como siempre en lo que se cuece por Bruselas)

.- El NIST saca un report sobre problemas en la monitorización de IA desplegada. Es compendio de lo que se hizo y dijo en dos talleres concretos, pero va al núcleo de problemas de control.

Attendees stated that organizations may choose to avoid monitoring due to its cost, implying a need either for “making monitoring cheap enough to be practical, or [for] companies being willing to engage in more expensive monitoring.” Baker et al. [70] predict a future where monitoring will be more expensive for agents: “Model developers may be required to pay some cost, i.e., a monitorability tax, such as deploying slightly less performant models or suffering more expensive inference, in order to maintain the monitorability of… agents.” The increased “cost structure if a human in the loop [is] required” was pointed out by attendees

.- Todos hemos oído eso de que la nueva big thing de la IA serán los “world models”. Lo que no vimos venir es que el primero que llega al ámbito comercial ha sido entrenado con tooodas aquellas imágenes captadas en las calles por los jugadores de Pokemon Go!. It´s 2016 all over again!!

📃El paper de la semana

.- Untangling AI Liability de Kenneth S. Abraham y Catherine M. Sharkey. Este demitificador paper propone un marco jurídico clásico para regular la responsabilidad civil por daños causados por IA. Argumenta que muchos desafíos del "problema de la caja negra" pueden resolverse con principios clásicos. El verdadero reto no es técnico, sino jurisprudencial: elegir entre reglas de responsabilidad uniformes o específicas en función del contexto. Respondiendo a su propia cuestión, los autores defienden un enfoque diverso, aplicando negligencia, responsabilidad objetiva o legislación específica en función del contexto.

.- User Privacy and Large Language Models: An Analysis of Frontier Developers’ Privacy Policies de Jennifer King, Kevin Klyman, Emily Capstick, Tiffany Saade, Victoria Hsieh: Por defecto los principales proveedores de IA entrenan con tus conversaciones salvo opt-out: los consumidores y menores quedan peor protegidos que clientes enterprise. Pero la principal moraleja es que el chat no captura solo inputs, sino también razonamientos, vulnerabilidades, preferencias y señales identitarias latentes. Se trata de un “cognitive surplus extraction”: no se monetiza la atención dispersa, sino líneas de pensamiento suficientemente estructuradas como para utilizarse como infraestructura de entrenamiento.

📎Herramientas útiles

.- El megabot que todos consideramos equivocadamente como humano Jorge Morell ha bicheado en Claude una herramienta de “AI Compliance checker”, basada en el toolkit que dió el ICO en excel. Juzguen ustedes mismo lo útil que ha quedado con las mejoras de Jorge: tutorial con 4 ventanas pop-up, traducido al castellano, ajustado para el RGPD no UK y RIA, y con el punto de que guarde la información si tienes cuenta en Claude

🙄 El chorradón final

Si crees que esta newsletter puede gustar e incluso ser útil a alguien, reenvíasela.

Si echas de menos algun doc, comentario o chorradón que manifiestamente debería haber estado en el Zero Party Data de la semana, escríbenos o deja un comentario y lo valoraremos para la próxima.