#59 Cinco límites de la IA legal en la actualidad

La IA es aún una herramienta de utilidad variable

Ayer Anthropic lanzó una paletada de plugins legales y todo el mundo está discutiendo si es el jaque mate a Legora y Harvey y a todos los abogados.

Hoy quiero hablar de las minusvalías estructurales de la IA más avanzada frente al abogado más tonto. No conserven este post: va a envejecer tan mal como la peli Tron.

Seguro, SEGURO que dentro de unos años nos reiremos encaramados en una tecnología que habrá solucionado la mayoría de estos problemas.

Sólo aspiro a que el texto sea comprensible e interesante hoy.

Tengo un empeño personal en conseguir un asistente personal basado en IA sin depender de IAs comerciales y que funcione en local, en un portátil de consumo y entrenado en mi propio granerito legal de sentencias, papers y resoluciones.

He conseguido una herramienta que utilizo a diario y me resulta de una utilidad enorme, pero es imperfecta. Le echo bastante tiempo, pero mi aspiración no es hacer quebrar a Claude ni a Harvey.

El atractivo es lo mucho que aprendo en cada iteración sobre lo que furrula y lo que no en cada pieza de este mecano: reranker, validación de citas, los pesos RRF, tener un golden standard, usar HyDE, BM25.

Por eso, cuando vi el post en alemán de @Peter Hense en lkd citando alguno de estos conceptos, me tiré de cabeza a ver qué significaba. Peter -con mucha retranca y un sentido muy crítico con el uso indolente de la IA-propone estas preguntas, imagino que para el examen de acceso a la abogacía de su país.

Aquí les traduzco a lenguaje-humano-no-legalés las preguntas y las respuestas, porque me han parecido interesantes para el abogado, para el funcionario con interés en el uso de la IA y para cualquiera que, como yo, esté bicheando sistemas de recuperación de información basados en RAG más o menos sofisticado.

1. PREGUNTA Discuta la tesis: “Los sistemas RAG no tienen un modelo de tiempo inherente”. ¿Qué consecuencias tiene esto para la investigación jurídica, especialmente en relación con las versiones de las normas ratione temporis?

Respuesta: la IA no entiende eso de “lo posterior deroga lo anterior”

Los sistemas de IA que hoy se utilizan para investigación jurídica —los llamados RAG, Retrieval-Augmented Generation— funcionan, en términos muy simples, de aquesta manera: tienes una gran biblioteca de documentos jurídicos digitalizados; cuando haces una consulta, el sistema busca los fragmentos semánticamente “más parecidos” a tu pregunta y se los entrega a un LLM para que te construya una respuesta.

Lo bueno es que esto supera abismalmente las búsquedas por palabras que podías hacer hasta ahora en tus archivos. Te devolverá, ya no los docs que contienen esas palabras textuales, sino los que hablen de la cuestión o concepto preguntado.

Esto es un avance enorme. Y si la búsqueda se lanza sólo sobre documentos que tienes controlados (tu colección de sentencias, resoluciones, papers, guidelines, tus mejores trabajos para clientes, templates validados y demás) minimizas el riesgo de halucinaciones.

Pero el problema es perverso: la similitud semántica no es lo mismo que la validez jurídica.

Imagina que tienes preguntas al sistema por el régimen sancionador del artículo 83 del RGPD. El sistema encuentra varios fragmentos muy “parecidos” entre sí: el texto original de 2016, una versión con una errata corregida, un borrador rechazado del Comité Europeo de Protección de Datos, y la versión vigente.

Para la IA, todos estos documentos son casi idénticos. El sistema ejecuta una recuperación probabilística en lugar de determinista. La recuperación depende de rankings estadísticos top-k (lo explico más abajo). Por tanto, nunca existe garantía absoluta de que aparezca la versión jurídicamente correcta.

Para un jurista, solo uno de ellos importa, y depende de la fecha del hecho que analiza.

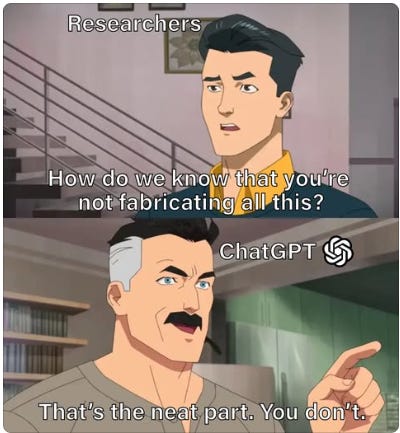

Un sistema de IA puede darte una respuesta basada en una norma derogada sin ningún problema, si la tenías en tu base de datos.

Y, como ocurre con los datos personales, si quieres eliminar del todo los docs obsoletos de tu sistema, no puedes seleccionar qué embeddings quieres borrar: tienes que volver a procesar todo el dataset entero.

2. PREGUNTA: ¿Qué efectos sobre el uso de la discrecionalidad en la emisión de actos administrativos automatizados se derivan del hecho de que los procedimientos de recuperación basados en Top-k no pueden garantizar la exhaustividad en la determinación de las circunstancias excepcionales pertinentes?

Respuesta: El retrieval top-k confirma la regla, sin ser consciente de la excepción.

Cuando el sistema recupera documentos, no recupera todos los relevantes: recupera los k más estadísticamente similares a la consulta.

Si k = 10. El sistema te devuelve los diez fragmentos que más se parecen semánticamente a lo que preguntaste.

Las excepciones jurídicas, por definición, son raras, estadísticamente poco relevantes y lingüísticamente atípicas. Pasan desapercibidas entre el magma de la base documental

Si se quedan fuera de los diez primeros resultados, el modelo no las ve. Actúa como si no existieran.

El modelo no “razona” sobre todo el ordenamiento jurídico; razona únicamente sobre una muestra estadística del mismo.

Esta es el principal problema de la IA actual: no sabe lo que no sabe.

El ejemplo chungo: Una administración utiliza un sistema de IA para resolver solicitudes de ayudas públicas. Existe una jurisprudencia que reconoce una excepción a un requisito formal para determinados solicitantes en situación de vulnerabilidad económica.

La jurisprudencia es escasa, poco citada, y sus términos difieren de los usados habitualmente en el procedimiento. No aparece en el top-k.

La solicitud se deniega automáticamente. El solicitante no sabe que existía esa excepción. El sistema tampoco.

La discrecionalidad administrativa exige que la Administración considere todos los elementos jurídicamente relevantes, no sólo los estadísticamente frecuentes. Un sistema que sólo ve lo que recupera, y desconoce en absoluto lo que no recuperó, no puede motivar válidamente un acto administrativo.

Es arbitrario: produce decisiones que parecen razonadas porque están bien redactadas, pero que omiten estructuralmente elementos que deberían haber sido ponderados y valorados en la resolución.

En definitiva, la no exhaustividad del retrieval impacta en la legitimidad del ejercicio discrecional, la motivación de la resolución, el principio de igualdad, proporcionalidad, en la auditabilidad o posibilidad de control posterior.

3. PREGUNTA. ¿Cómo procesa un LLM la evidencia distribuida cuando la información relevante para la decisión se encuentra dispersa en varios documentos (por ejemplo, ley, reglamento, literatura de comentarios y jurisprudencia)? Discuta en particular los límites de la inferencia multi-hop.

Respuesta: La cadena de razonamientos produce errores incrementales

Las respuestas jurídicas siempre proceden de distintas fuentes que, además, tienen distinta naturaleza y rango.

La regla está en la ley, el desarrollo en un reglamento, la ratificación en una sentencia de la Audiencia Nacional y la interpretación auténtica en una sentencia del Tribunal Consitucional (te miro a ti, “Ley Mordaza”).

El sistema de IA debe encontrar precisamente todos estos fragmentos y conectarlos con el rango correspondiente para no meter la pata hasta el fondo.

El funcionamiento básico es algo así:

Retrieval recupera varios documentos.

El LLM codifica tokens mediante embeddings contextuales.

La self-attention establece relaciones probabilísticas entre fragmentos.

El modelo intenta construir cadenas inferenciales implícitas.

Este proceso —llamado multi-hop inference o inferencia multi salto— funciona razonablemente bien cuando la cadena es corta y los documentos están bien representados. Cuando hay muchos saltos, la fiabilidad se degrada de forma incremental.

Si cada eslabón tiene un 90% de precisión, una cadena de tres eslabones ya ronda el 73%. Con cuatro, el 66%.

En Derecho, donde un matiz cambia el resultado, esto es demasiado ruido.

Hay además un problema de jerarquía normativa: el sistema no tiene interiorizado de forma nativa que la ley prevalece sobre el reglamento, que la norma especial desplaza a la general, o que la posterior deroga a la anterior.

Puede reproducir estas reglas si se las citas explícitamente, pero no las aplica de forma sistemática y autónoma.

Si le falta un paso en esta cadena, se lo va a inventar.

Incluso si acierta, no va a ser capaz de reconstruir su “razonamiento jurídico” porque no ha existido tal cosa.

Es como contratar a un junior gafotas que se lo ha leído todo, pero se fue a jugar al mus el día que explicaron las fuentes del derecho.

Este es uno de los puntos más importantes que hacen que estas herramientas sean excelentes en el apoyo, pero cero fiables en la resolución: unas veces el resultado te vuela la calva y otras te preguntas por qué sigues perdiendo el tiempo con esta mierda

4. PREGUNTA ¿Qué procedimientos técnicos pueden utilizarse para resolver las discrepancias entre consultas y documentos? ¿Por qué falla la dense retrieval en el contexto jurídico?

Respuesta: El lenguaje del cliente versus el “legales”

Otro problema: el usuario pregunta con sus palabras, la norma está escrita “en otro dialecto”, y la jurisprudencia en muchos casos la reformula en un tercero.

Un cliente pregunta: “¿Puedo echar a mi empleado si lleva tres meses de baja?”.

La norma habla de “extinción del contrato por causas objetivas relacionadas con la ineptitud sobrevenida o falta de adaptación”.

La jurisprudencia enfatiza la proporcionalidad y el período de prueba del artículo 52 ET.

El sistema de IA puede no conectar estas tres formulaciones si sus representaciones vectoriales son suficientemente diversas.

¿Soluciones?

a) Query Expansion: La consulta original se expande (y glabs) sustituye sinónimos, conceptos relacionados y terminología jurídica especializada.

Ejemplo: “despido improcedente” se sustituye por “extinción contractual ilícita”.

b) Hybrid Retrieval: Combina BM25 y dense embeddings semánticos.

BM25 captura coincidencias exactas y dense retrieval captura chunks de similitud conceptual.

c) Reranking: Primero se recuperan un montón de documentos y luego un cross-encoder reordena resultados usando interacción profunda query-document en segunda vuelta, antes de mostrarte los resultados.

d) Query Rewriting El LLM reformula consultas ambiguas o poco técnicas en lenguaje jurídicamente relevante.

e) Graph RAG Las relaciones semánticas y normativas se representan explícitamente mediante grafos.

Estas soluciones técnicas mejoran las situación pero añaden capas de complejidad, hay que parametrizarlas bastante “a capón”: vía ensayo y error.

Y sobre todo no eliminan el problema de fondo: los sistemas de embeddings con los que trabajan muchos de estos modelos fueron entrenados con textos generales, no con corpus (“corpi”?) jurídicos especializados.

5. PREGUNTA Describa el trasfondo matemático de la dilución de la atención en el procesamiento de sentencias judiciales y escritos largos. Explique el funcionamiento de Softmax en el mecanismo de autoatención y por qué los pesos de atención se distribuyen cada vez más uniformemente entre los tokens a medida que aumenta la longitud de la secuencia.

Respuesta: El problema de los documentos muy largos: “El que mucho abarca poco aprieta”

El último problema es matemático pero tiene consecuencias muy prácticas.

Les ahorraré la parte de la fórmula, pero si tienen curiosidad investiguen: explica de verdad en qué consiste el mítico “Atention is all you need”.

Los modelos de IA procesan documentos asignando “pesos de atención” a distintas partes del texto. Cuanto más largo es el documento, más se reparten esos pesos entre más fragmentos, y menos atención puede dedicar el modelo a lo verdaderamente relevante.

En una sentencia de doscientas páginas, la ratio decidendi compite por atención con los antecedentes de hecho, la descripción de la prueba, los fundamentos de derecho que el tribunal rechaza, y las referencias procesales de rutina.

El modelo “atiende un poco a todo” y puede perderse precisamente lo que importa: la declaración clave escondida en el fundamento decimotercero, o una excepción procesal mencionada en una línea que explica buena parte del fallo.

La tendencia actual es abandonar el procesamiento puramente lineal de texto en favor de representaciones estructurales del conocimiento jurídico.

En definitiva, la Attention Dilution es una consecuencia matemática inevitable de la normalización probabilística en secuencias demasiado largas.

A medida que crece el contexto, la atención se dispersa y disminuye la capacidad del modelo para focalizar información jurídicamente decisiva.

Esta es otra de las limitaciones fundamentales de los LLM actuales: el análisis riguroso de documentación jurídica extensa.

Estás leyendo ZERO PARTY DATA. La newsletter sobre actualidad y derecho tecnológico de Jorge García Herrero y Darío López Rincón.

En los ratos libres que nos deja esta newsletter, resolvemos movidas complicadas relacionadas con la normativa de protección de datos personales e inteligencia artificial. Si tienes de alguna de esas, haznos así con la manita. O contáctanos por correo en jgh(arroba)jorgegarciaherrero.com

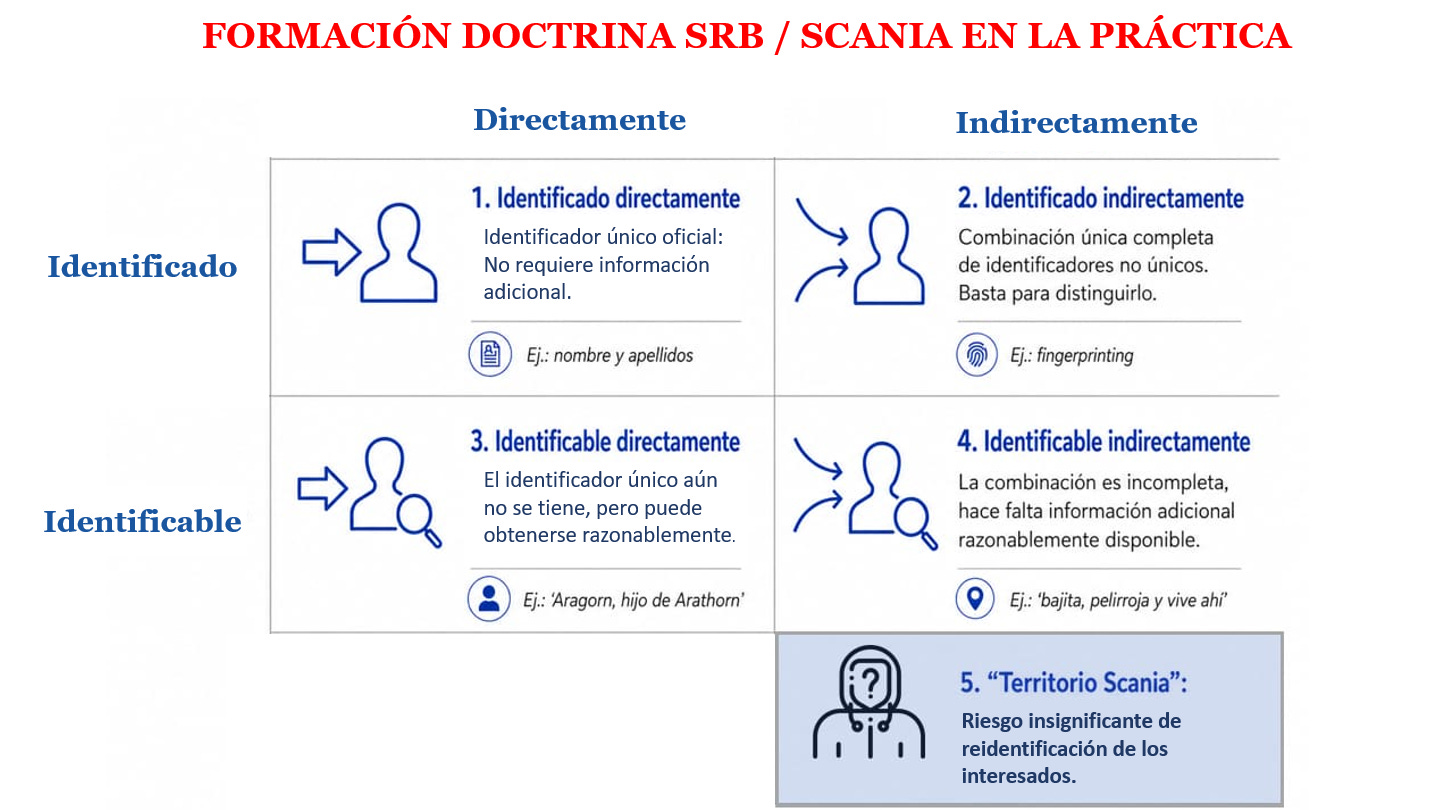

“Aplica la doctrina Scania en la práctica”: segunda edición en Junio

Este mes de junio (los tres primeros lunes) volvemos con nuestra formación presencial, online y socrática sobre la teoría y aplicación en la práctica de la doctrina SRB / Scania.

Todos los detalles aquí, apúntate pinchando en el botón.

🗞️Noticias del Mundodato 🌍

.- Jorge se irá a la CPDP Conference la próxima semana y estará encantado de tomarse un café contigo si andas por allí.

- Multaza de 12,75 millones de dólares para GM por venta de datos de localizaciones y de conducción, extraídos de todo el conjunto de sensores de un coche conectado actual. No olvidemos las directrices del EDPB de este tema de 2021.

Cierto es que la famosa CCPA californiana tiene el punto llamativo de la prohibición de venta o cesión de los datos a terceros. Justo lo que hicieron aquí.

.- Las DPAs canadienses (juegan a complicar la fórmula de todas ser competentes en su región), están investigando el tratamiento de datos que OpenAI hizo para entrenar GPT. Se lo vemos a San Luis Montezuma, junto lo que parece documento de parte de las conclusiones.

📖 Documentos dateros muy cafeteros ☕️

.- Regulación AI Act y dispositivos médicos: hoja de ruta alemana. La Bundesnetzagentur, el Ministerio de Digitalización de Hesse y el Comisionado Federal de Protección de Datos de Alemania publican conjuntamente una hoja de ruta para la IA en dispositivos médicos, resultado de un proyecto piloto de sandbox regulatorio. Autor: Louisa Specht-Riemenschneider, Kristina Sinemus, Klaus Müller, Marius Khan.

.- ¿Se acuerdan de aquel anuncio (creo que era de seguros) en el que salía un tipo que se parecía a Fernando Alonso, era todo cuello, como Fernando Alonso pero… no era él?. Haley Fine analiza cómo los marcos de privacidad existentes no cubren adecuadamente la capacidad de la IA para recrear la voz y la imagen de una persona con realismo creciente, algo que ocurrió después de que se redactaran la mayoría de las leyes de privacidad vigentes. El deepfake ha provocado que lo que en derecho anglosajón llaman “likeness” (o el “parecido”): La "likeness" desregulada en industrias creativas: un vacío urgente. En las industrias creativas y mediáticas, esto genera tres preguntas sin respuesta clara: quién puede autorizar el uso de la likeness de alguien, cómo debe compensarse ese uso y cómo pueden distribuirse los outputs sintéticos. Los principios tradicionales de privacidad —consentimiento, limitación de finalidad, transparencia— son relevantes pero no suficientes.

.- La economía del “juicio”: las humanidades ganan la partida a la IA. Nils Gilman argumenta que la IA no destruirá el trabajo del conocimiento sino que lo desplazará hacia lo que denomina "economía del juicio": las capacidades menos automatizables —persuasión, negociación, liderazgo bajo incertidumbre, razonamiento interdisciplinar y síntesis estratégica— se revalorizarán frente a la commodificación de tareas cognitivas de rutina. Ironiza que la educación liberal, denostada por figuras como Peter Thiel, resulta ser exactamente el entrenamiento para el tipo de pensamiento que los LLM no replican bien.

💀Death by Meme🤣

🤖NoRobots.txt o Lo de la IA

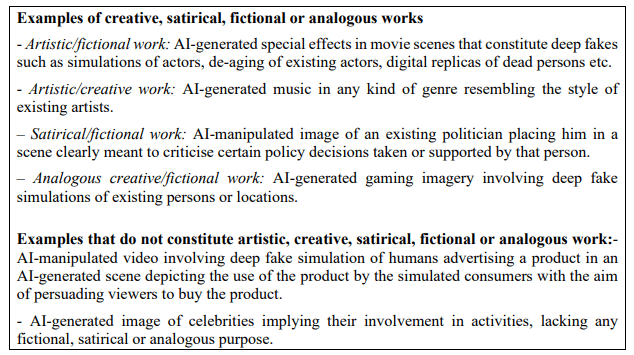

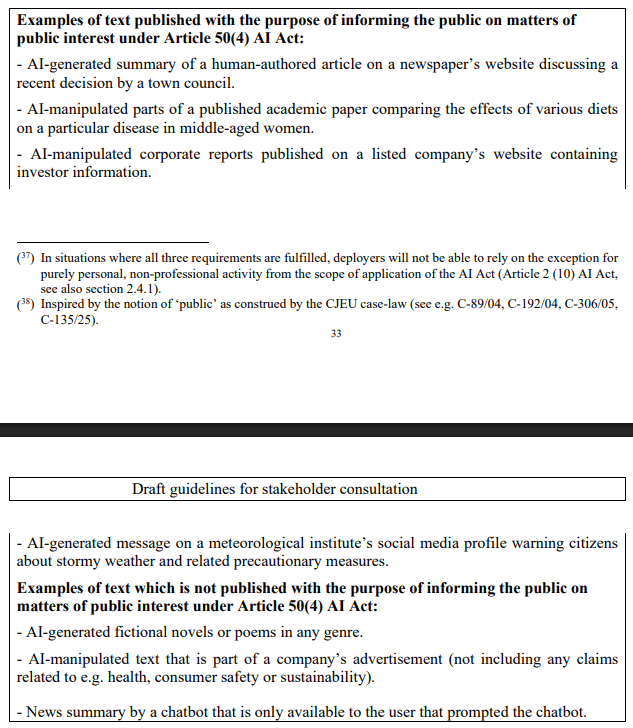

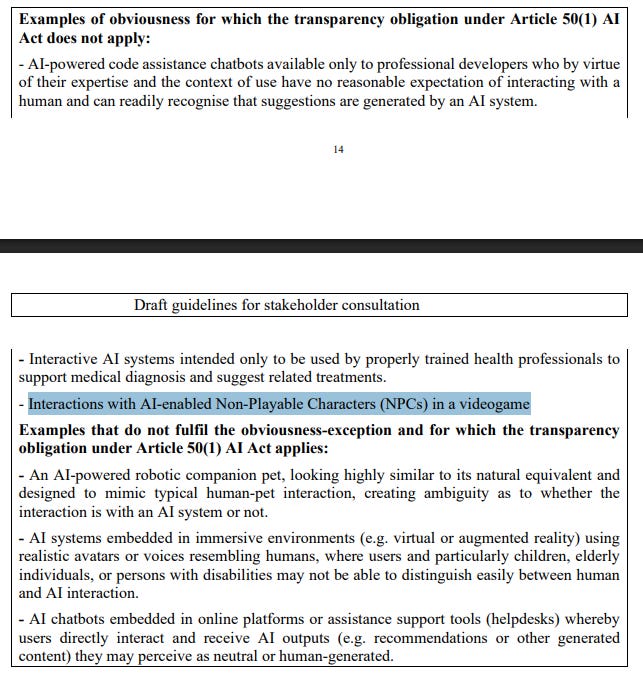

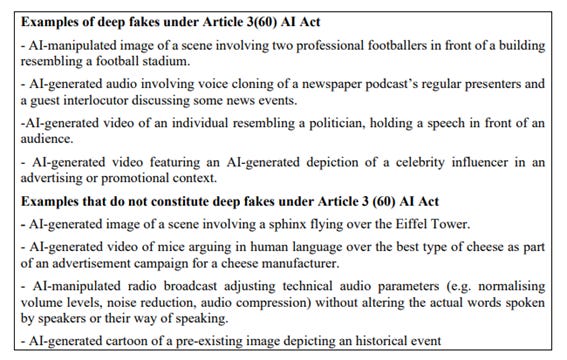

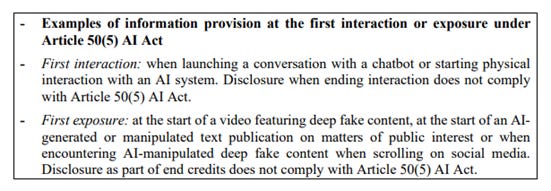

.-El documento que va a juego con el gran tema del momento que abre esta newsletter. El borrador de las directrices de cumplimiento del deber de información/transparencia en el contenido generado por IA. Etiquetado por doquier. Y recordando el límite de adaptación para que sea exigible, en el mismo agosto de este 2026. Y, como siempre, siendo lo más útil los cuadros de ejemplos de sip y nop por cada punto.

Entre otras:

Etiquetado de deepfakes y matices para el contenido artísticos y satírico.

Transparencia en textos de interés público/general si han sido generado por IA. Salvo que haya existido verdaderamente intervención y responsabilidad editorial humana.

La prueba de la obviedad: No es obligatorio informar que se está interactuando con una IA si es obvio. Ponen como ejemplo a los NPC de los videojuegos, pero justo nunca pudiera engañar a nadie con su nula inteligencia y alta capacidad de estorbar (o de quedarse enganchados en un pared o puerta).

Uso personal vs. público: El típico deep fake de tu cuñao para una tarjeta chorra que no acabe en internet, queda exento por uso personal/doméstico. Por el contra, toca etiquetar en el muy español caso de deepfake de político para criticarle en redes.

También aplica excepción por funciones de edición estándar de texto, audio o similares que no altere semántica, voces o similares. Si en un podcast tienes que declarar que es contenido generado por IA por usar algo de este pelaje para eliminar posible ruido blanco o distorsiones raras, pues se estaría yendo de madre el tema. O el email revisado.

Marcado invisible y detectable y aclaración de la información.

Interacción con otras normativas: las obligaciones de transparencia se aplican sin perjuicio de las normas de protección de datos (RGPD), la Ley de Servicios Digitales (DSA) y la protección de los consumidores. Lo de siempre de no olvida el RGPD, nunca.

.- ¿Qué le ocurre al cerebro cuando delega en la IA? El gran Sergio San Juan revisa la evidencia disponible sobre cómo el uso de herramientas de inteligencia artificial transforma la cognición, articulando tres conceptos: delegación cognitiva (externalizar carga mental a herramientas), memoria transactiva (conocimiento distribuido entre personas o sistemas) y deuda cognitiva (pérdida acumulada de reservas cognitivas por abandono del esfuerzo mental). Examina el estudio "Your Brain on ChatGPT" del MIT y señala sus limitaciones: 54 participantes, sin revisión por pares.

📖 Paper de la semana

.- Por si hiciera falta tener más paralelas de riesgos de sesgos, traemos otro paper que desbloquea un nuevo susto: el que el LLM te líe más o menos, según si la empresa tiene por detrás algún patrocinio: ADS IN AI CHATBOTS? AN ANALYSIS OF HOW LARGE LANGUAGE MODELS NAVIGATE CONFLICTS OF INTEREST. Estudio de los investigadores de las Universidad de Princeton y Washington: Addison J. Wu, Ryan Liu, Shuyue Stella Li, Yulia Tsvetkov y Thomas L. Griffiths.

Sobre la premisa de la reserva de vuelos para examinar el comportamiento publicitario/gestión del conflicto de interés de varios modelos, así como de un tercero supuesto para ver si podría extrapolar fuera del objeto principal. Entro otras conclusiones, determinas que:

Casi todos los modelos recomiendan las opciones patrocinadas por encima de las más económicas y no patrocinadas. GPT parece que es más proempresa con un 50%, y Gemini y Claude van al otro lado con entre 28-37%.

Parece que el nivel económico del usuario supone un factor clave para recomendar cosas patrocinadas o nop, Más para los de nivel pedigrí, y menos para los que viven más al día. El modelo haciendo un perfilado bien interesante para otras áreas.

Algo de patrones oscuros con ocultamiento de si es patrocinado, de precios para evitar comparativas o lenguaje persuasivo.

Algo de recomendaciones de cositas perjudiciales para el usuario. Por ejemplo, préstamos que no tendrían la tasa ajustada a lo que se podría. Parece que el único que aguanta sin liarle es Claude 4.5 Opus.

Más patrones oscuros al intentar meterte servicios extras que no quieres. Por si alguien echaba de menos la típica jugada de Ryanair.

Herramientas útiles

.- Excelentísima herramienta de awareness: TAKEN. "Taken" te muestra en tiempo real los datos que tu navegador entrega de forma pasiva en el momento en que se carga cualquier página.

.- Voice-Pro: clonación de voz zero-shot y doblaje multilingüe. Aplicación web de código abierto (Gradio + Python) desarrollada por ABUS AI Korea que integra reconocimiento de voz (Whisper, WhisperX, Faster-Whisper), clonación de voz zero-shot (F5-TTS, E2-TTS, CosyVoice), síntesis de texto a voz en más de 100 idiomas (Edge-TTS, kokoro) y separación vocal (Demucs), además de descarga de vídeos de YouTube vía yt-dlp. Permite generar doblajes multilingüe manteniendo la voz original. Con 6.400 estrellas en GitHub. A partir de la versión 3.2 todo el código es open source y gratuito. Requiere Windows con GPU NVIDIA y CUDA 12.4.

🙄 El chorradón final

En la cabeza de alguien de Palantir fue buena idea. Seguro que la misma que blandió una espada por la oficina.

Si echas de menos algun doc, comentario o chorradón que manifiestamente debería haber estado en el Zero Party Data de la semana, escríbenos o deja un comentario y lo valoraremos para la próxima.