IA generativa: Obligaciones de transparencia en el Reglamento de IA. Segunda parte: Imagen, Vídeo y Audio (y deepfakes)

¡Marcar cera! ¡Etiquetar cera!

1 Qué y por qué

El RIA regula la transparencia como pilar fundamental de la gobernanza tecnológica, no sólo para prevenir el engaño malintencionado a personas o grupos concretos, sino también para preservar la integridad del ecosistema de información global.

Es decir, no sólo pretende proteger derechos individuales, sino también el funcionamiento del sistema política y social europeo.

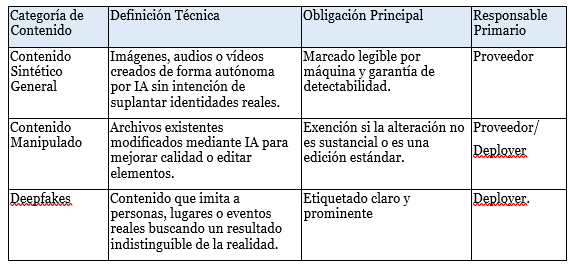

El contenido sintético se define, en términos generales, como cualquier activo digital -ya sea texto, imagen, audio o vídeo- generado o manipulado sustancialmente mediante sistemas de IA.

La obligación de transparencia se manifiesta a través de dos dimensiones operativas: el marcado legible por máquina y el etiquetado perceptible por humanos.

· El marcado (machine-readable marking) se refiere a la integración de señales técnicas, como metadatos cifrados o marcas de agua digitales, que permiten a otros sistemas identificar de manera automática el origen artificial de un archivo

· El etiquetado (labeling) se orienta a la percepción del usuario final, utilizando indicadores visuales o auditivos que informan sobre la naturaleza de la IA en el momento de la exposición.

El Artículo 50 del Reglamento de IA de la UE, impone la obligación de transparencia para contenidos sintéticos generales (no deepfakes) principalmente sobre los proveedores de la tecnología, quienes deben asegurar que sus sistemas “marquen” los resultados de forma nativa.

Si el tema te interesa, definitivamente deberías echar un vistazo a la primera parte de esta serie (obligaciones de transparencia en relación con texto generado con IA) o a los posts sobre usos internos vs comerciales de modelos open source, o supervisión humana efectiva de sistemas de IA.

Les prometo que el resto del texto está escrito bastante en serio, pero en este momento no puedo evitar hacer un homenaje a Karate Kid, con la secreta esperanza de que les sirva como regla nemotécnica para recordar que a los providers se les impone marcar (cera) y a los deployers, etiquetar (cera).

Estás leyendo ZERO PARTY DATA. La newsletter sobre actualidad, tecnopolios y derecho de Jorge García Herrero y Darío López Rincón.

En los ratos libres que nos deja esta newsletter, estamos especializados en resolver movidas complicadas en protección de datos personales. Si tienes de alguna de esas, haznos así con la manita. O contáctanos por correo en jgh(arroba)jorgegarciaherrero.com

¡Gracias por leer Zero Party Data! Apúntate!

2 El Artículo 50 del Reglamento de IA

El Reglamento de IA de la Unión Europea representa el primer intento integral de codificar estas obligaciones a nivel internacional.

El RIA adopta una aproximación “basada en el riesgo”, clasificando a la IA generativa dentro de la categoría de riesgo limitado.

En consecuencia, impone requisitos de transparencia específicos diseñados para fomentar confianza y trazabilidad.

2.1 Obligaciones para los proveedores de sistemas de IA generativa

El Artículo 50(2) establece que los proveedores de sistemas de IA, - bien especializados o bien de propósito general (GPAI)-, que generen contenido sintético de audio, imagen, vídeo o texto (deepfakes o no), deben garantizar que los outputs estén marcados en un formato legible por máquina.

Esta obligación es independiente de la finalidad de la generación o publicación del contenido: ya sea una imagen artística generada para un blog o un audio de ambiente para un videojuego, la marca técnica es obligatoria.

La ley exige que estas soluciones sean “eficaces, interoperables, sólidas y fiables“ en la medida en que el estado de la técnica lo permita.

En consecuencia, el proveedor no solo debe insertar una marca, sino que ese marcado debe ser resistente a intentos de eliminación o manipulación por terceros malintencionados.

Además, los proveedores deben facilitar mecanismos de detección gratuitos -como APIs o herramientas de verificación pública (“oráculos”)- para que los Deployers y otros usuarios puedan comprobar si un archivo específico fue generado por su IA.

2.2 Exenciones

Sin perjuicio de lo anterior, el Reglamento de IA europeo ha previsto escenarios donde la transparencia estricta podría ser contraproducente o innecesaria.

· Sistemas de IA que funcionan como “asistentes para la edición estándar”. Esto incluye herramientas que no alteran sustancialmente los datos de entrada o su semántica, como correctores de color en fotografía, sistemas de reducción de ruido en audio o herramientas de estabilización de vídeo.

· Sistemas de IA utilizados exclusivamente con fines de investigación científica y desarrollo.

· Componentes de IA que se distribuyen bajo licencias de código abierto gratuitas, a menos que dichos modelos ostenten riesgos sistémicos.

· La famosa exención doméstica: el uso puramente personal y no profesional: un individuo que genera una imagen para su uso privado no está sujeto a las mismas obligaciones de etiquetado que una empresa que distribuye contenido comercial.

3 El Código de buenas prácticas de la UE y fechas de aplicación de todo esto

Dado que el texto del Reglamento de IA proporciona principios legales pero no especificaciones técnicas, la Comisión Europea ha publicado un “Código de Buenas Prácticas sobre Transparencia”.

En marzo de 2026 se ha publicado su segunda versión que es la comentada aquí.

Este Código de buenas prácticas busca cerrar la brecha entre la obligación legal y la realidad técnica, estableciendo lo que se considera el “estado de la técnica” en relación con el marcado y la detección de contenidos sintéticos.

¿Qué valor tiene este documento?

El código no es obligatorio en sí: sólo para las empresas que lo suscriban.

La suscripción de este código no presume ni acredita el cumplimiento del RIA (las organizaciones que no lo firmen podrán acreditar su cumplimiento por vías distintas).

Pero en la práctica la idea es que el Código se convierta en el estándar de cumplimiento en las inspecciones de las autoridades competentes.

La tercera versión (la final) del código se espera para junio y también están previstas unas Guidelines oficiales de la Comisión Europea, pero todo esto se conocerá ya escasas semanas antes de la entrada en vigor del RIA.

El problema es que, con el calendario a la vista, lleguen o no lleguen a tiempo dichos documentos, será muy complicado implementar en la práctica sus novedades a tiempo para dicha fecha de aplicación: 2 de agosto de 2026.

Por último: el RIA será de aplicación a los sistemas de IA que se pongan en producción a partir de agosto de 2026. En relación con los que estén en el mercado antes, se está debatiendo dos plazos transitorios: tres o seis meses desde ese 2 de agosto.

3.1 Marcado multicapa

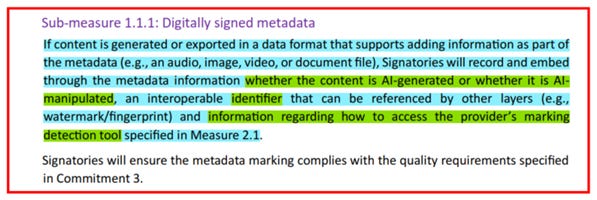

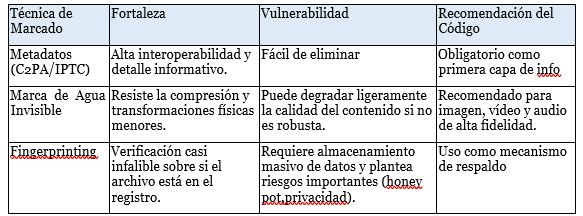

El segundo borrador del Código reconoce[1] (ojo con esto) que el estado de la técnica no permite cumplir todos los requisitos previstos por el RIA con un solo medio o herramienta y por eso propone que los Proveedores no se limiten a una única técnica de marcado, sino que implementen un enfoque de múltiples capas para asegurar la resiliencia del sistema.

Este enfoque se divide en tres niveles fundamentales:

1. Integración de metadatos: Consiste en insertar información de procedencia y firmas digitales directamente en la cabecera del archivo (como las etiquetas XMP o IPTC). Aunque es la técnica más fácil de implementar, también es la más vulnerable, ya que muchos editores de imagen y redes sociales eliminan los metadatos de forma automática al procesar los archivos.

2. Marcas de agua imperceptibles (Watermarking): Esta técnica implica incrustar señales digitales directamente en los píxeles de una imagen o en las frecuencias de un audio. Estas marcas son invisibles o inaudibles para el ser humano, pero permanecen incluso si el archivo se comprime, se recorta o se cambia de formato. El Código sugiere que estas marcas se integren tanto durante el entrenamiento del modelo como durante la fase de inferencia (generación).

3. Huellas digitales y registros de salida (Fingerprinting / Logging): Como última capa de seguridad, se espera que los proveedores mantengan una base de datos o un registro de los hashes de los contenidos generados. Esto permite que, si un contenido pierde sus metadatos y su marca de agua, un sistema de detección pueda identificarlo comparando su hash o “huella digital” única con el registro del proveedor.

EL código obliga a los signatarios (providers, deployers) a

(i) abstenerse de eliminar o modificar este marcado y a

(ii) imponer, mediante políticas de uso aceptable (o información en el caso de modelos open source) la misma obligación a terceros, aguas abajo.

3.2 Requisitos de calidad y rendimiento técnico

El cumplimiento no se basa sólo en “hacerlo”, sino en hacerlo de forma efectiva.

El Código establece que las soluciones de detección deben demostrar niveles bajos de falsos positivos y falsos negativos.

Los proveedores deberán someter sus herramientas a evaluaciones independientes y benchmarks verificados para demostrar que sus soluciones alcanzan el estándar de rendimiento exigido por la Oficina de IA.

4 Etiquetado obligatorio para deepfakes

Un deepfake, en el sentido del RIA[1] es contenido de imagen, audio o vídeo generado o manipulado por IA que se asemeja apreciablemente a personas, objetos, lugares, entidades o eventos existentes, y que una persona razonable podría percibir falsamente como auténtico o veraz.

Todo contenido deepfake (sea de imagen, vídeo o audio) generado o manipulado por IA debe ser etiquetado de forma clara, distinguible y accesible, a más tardar en el momento de la primera exposición del usuario al contenido.

El Código de Prácticas establece requisitos específicos según la modalidad.

• Elemento visual principal: el acrónimo “AI” en mayúsculas, opcionalmente acompañado de texto como “Generated with AI”, “Made by AI” o “Manipulated with AI”.

• Ratio de contraste mínimo: 4,5:1 entre la etiqueta y el fondo.

• Portabilidad: en la medida de lo técnicamente posible, la etiqueta debe “viajar” con el contenido cuando se redistribuya.

• Accesibilidad: textos alternativos para lectores de pantalla, señales táctiles para contenido solo audio (cuando el dispositivo lo permita), compatibilidad con tecnologías de asistencia.

5 Reglas específicas por modalidad de deepfake

5.1 Imagen

Para imágenes, el icono o etiqueta debe mostrarse de forma consistente desde la primera exposición y en cada exposición posterior. La etiqueta debe ser claramente distinguible de la propia imagen: prominente, no oculta dentro de capas de la imagen, no demasiado próxima a otros iconos o textos, y no mostrada sobre fondos que reduzcan su visibilidad.

5.2 Vídeo en tiempo real (emisión en directo, livestreaming)

Para vídeo en directo, el icono debe mostrarse de forma consistente durante toda la exposición, siempre que sea factible. Si la divulgación se realiza también por audio, debe presentarse simultáneamente con el icono visual. Como alternativa, se puede usar un aviso visual o sonoro al inicio y a intervalos regulares durante la emisión.

5.3 Vídeo pregrabado

• Vídeos largos: icono o etiqueta al menos al inicio, repitiéndose a intervalos regulares (por ejemplo, cada vez que aparezca el contenido deepfake o tras pausas publicitarias).

• Vídeos cortos: icono o etiqueta visible de forma consistente durante toda la duración. Si el vídeo es íntegramente generado o manipulado por IA, debe indicarse durante toda la reproducción.

• Créditos: se puede incluir un aviso en los créditos finales, pero esto siempre debe ir acompañado de alguna de las opciones anteriores. No basta solo con los créditos.

5.4 Audio

• Audio menor de 30 segundos (anuncios, cuñas publicitarias): aviso sonoro breve al inicio del contenido, como mínimo.

• Audio de mayor duración (podcasts, llamadas generadas por IA, emisiones de radio): avisos sonoros repetidos al inicio, en fases intermedias apropiadas y al final del contenido.

• Idioma: el aviso debe hacerse en lenguaje natural, claro y sencillo, en el mismo idioma que el contenido.

• Audio con interfaz visual (reproducción en pantalla de móvil, coche, etc.): además del aviso sonoro, se debe mostrar un icono o etiqueta visual en los elementos de la interfaz bajo control del desplegador.

5.5 Contenido multimodal

Para contenido que combine varias modalidades (imagen-texto-audio, imagen-audio, texto-audio, imagen-texto), la divulgación debe hacerse mediante un icono o etiqueta que sea claramente perceptible sin necesidad de interacción adicional por parte del usuario.

6 Excepciones

6.1 “No-excepciones”

· No aplica la “exención editorial” a los deepfakes.

· Obligatorio aunque la persona “clonada” haya prestado su consentimiento explícito.

6.2 Excepciones adicionales

1. Uso autorizado por ley para la detección, prevención, investigación o persecución de delitos. Esta excepción tiene unas piernas muy cortas en el sector privado.

2. Obras artísticas y creativas

Para contenido deepfake que forme parte de una obra evidentemente artística, creativa, satírica, ficticia o análoga, la obligación de transparencia (etiquetado) se atenúa pero no desaparece.

La divulgación debe hacerse de forma que no perjudique la exhibición ni el disfrute de la obra. Las opciones incluyen:

• Vídeo en directo o casi en directo: icono en las esquinas superior o inferior durante al menos cinco segundos al inicio (por ejemplo, durante los créditos de apertura), sin necesidad de repetirlo durante el resto de la exposición.

• Vídeo pregrabado: divulgación con duración suficiente al inicio, sin interferir con la experiencia.

• Imagen: etiqueta al inicio de la primera exposición, pudiendo integrarse en la imagen o su fondo siempre que el usuario pueda distinguir el etiquetado.

• Audio: aviso sonoro al inicio de la primera exposición.

• Contextos no digitales (exposiciones, galerías, festivales): la divulgación puede hacerse en el punto de entrada o al vender las entradas.

Jorge García Herrero

Abogado y Delegado de protección de datos

[1] Duras palabras en el código: “So long as no single marking approach is sufficient, under the state of the art, to comply with the four requirements in Article 50(2) AI Act of effectiveness, interoperability, robustness and reliability, Signatories will implement a multi-layered marking approach to ensure that the outputs of their generative AI systems are marked with at least two layers of machine-readable active marking, as specified in the sub-measures below” (pg 10).

[2] Art 3(60) del AI Act